杜德慧教授课题组研究成果助力突破人工智能可解释性难题,赋能应用软件开发

上海软件工程学院(滴水湖国际软件学院)杜德慧教授课题组在人工智能可解释性领域取得突破性研究进展,其成果为破解当前人工智能(尤其是深度学习模型)的“黑箱”困境提供了创新性的理论框架与技术路径,显著提升了复杂模型的透明度与可信度。这一进展对于推动人工智能在关键领域,特别是人工智能应用软件开发中的安全、可靠与深度集成具有里程碑式的意义。

一、 研究背景:人工智能可解释性的时代之问

随着深度学习技术的飞速发展,人工智能系统在图像识别、自然语言处理、决策推荐等众多软件应用场景中展现出卓越性能。其内部复杂的网络结构与海量参数运算往往像一个“黑箱”,使得开发者与用户难以理解模型做出特定判断或决策的内在逻辑与依据。这种“黑箱”特性导致了多重挑战:在医疗诊断、金融风控、自动驾驶等高风险领域,缺乏解释性会引发对系统安全性与公平性的担忧;在软件开发与维护过程中,开发人员难以调试和优化模型,阻碍了高效、可靠的AI应用开发流程。因此,实现人工智能的可解释性(XAI)已成为推动AI技术走向成熟、可信、广泛落地的核心关键。

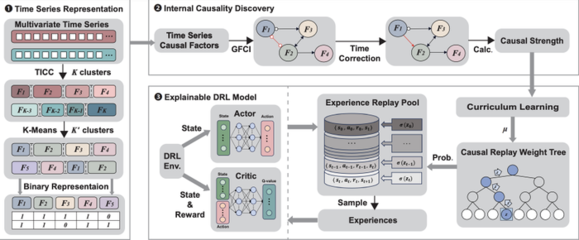

二、 核心突破:理论创新与关键技术

杜德慧教授课题组长期致力于软件工程与人工智能的交叉研究。本次突破性成果聚焦于为深度学习模型构建一套模块化、层次化的可解释性框架。该框架的核心创新点在于:

- 因果推理与特征归因的深度融合:课题组提出了一种新的算法,能够不仅识别出对模型输出贡献最大的输入特征(传统归因方法),更能推断这些特征与输出结果之间的潜在因果关系。这帮助开发者理解是哪些“因”真正导致了模型的“果”,而不仅仅是相关性,极大提升了解释的深度与可靠性。

- 面向开发过程的动态解释生成:研究将可解释性技术深度融入软件开发的生命周期。针对人工智能应用软件开发的不同阶段(如设计、训练、测试、部署),框架能够自动生成适配该阶段的解释报告。例如,在模型训练阶段,提供神经元激活模式分析以辅助网络结构调整;在测试阶段,生成对抗性样例的可解释分析以评估模型鲁棒性;在部署后,为用户或监管方提供简洁、人性化的决策理由说明。

- 可解释性指标的软件工程化度量:课题组借鉴软件质量保障的思想,定义了一套用于量化评估模型可解释性“好坏”的标准化指标,如解释一致性、稳定性和用户认知负担等。这使得可解释性不再是模糊的概念,而成为软件开发过程中可以设定、度量并持续优化的明确质量属性。

三、 对人工智能应用软件开发的赋能价值

该研究成果直接面向并深刻改变了人工智能应用软件开发的范式:

- 提升开发效率与质量:开发人员能够像调试传统软件一样,“透视”AI模型的行为逻辑,快速定位性能瓶颈、偏差(Bias)来源或逻辑错误,从而进行精准的模型优化与迭代,缩短开发周期,提升最终软件产品的质量与可靠性。

- 降低集成与部署风险:在将AI模块集成到大型软件系统时,清晰的可解释性报告有助于系统架构师评估AI组件与其他模块的交互影响,预测潜在风险,确保系统整体行为的可控与稳定,满足日益严格的行业合规要求(如GDPR的“解释权”)。

- 增强用户信任与体验:在最终的用户界面或服务中,集成的可解释功能能够以可视化、自然语言等形式,向终端用户清晰展示AI决策的依据。例如,在医疗辅助软件中解释为何推荐某项检查,在信贷审批软件中说明拒贷的关键因素。这极大地增强了用户对AI驱动型软件的信任感和接受度,提升了产品竞争力。

- 催生新型开发工具与平台:该研究成果为开发下一代智能软件开发工具(AI for Software Engineering)提供了核心组件。集成可解释性引擎的IDE插件、自动化测试平台和运维监控系统将成为AI应用开发者的标配,推动整个行业向更高水平的智能化、自动化迈进。

四、 未来展望

杜德慧教授表示,课题组下一步将继续深化研究,推动可解释性技术与具体软件工程方法论(如敏捷开发、DevOps)的融合,并探索在联邦学习、大语言模型等更复杂场景下的应用。上海软件工程学院(滴水湖国际软件学院)也将以此为契机,加强在可信AI、智能软件工程等方向的学科建设与人才培养,为上海乃至全国的科技创新与产业升级持续输送高端复合型人才。

此项研究标志着我国在人工智能基础研究与软件工程实践结合领域取得了重要进展,为构建透明、可信、易用的人工智能生态系统,特别是赋能千行百业的人工智能应用软件开发,奠定了坚实的技术基石。

如若转载,请注明出处:http://www.krtnxn.com/product/9.html

更新时间:2026-05-22 05:02:16